2.1 域名选择

网站域名选择,不仅能快速直观让用户了解网站定位,域名设置,更会影响搜索对网站的抓取情况。因此,选择简单好记且安全的域名,是网站搭建前期最重要的一步。

2.1.1 域名选择的注意事项

网站搭建之初,对网站域名选择,建议域名独立,简单好记;独立移动站域名选择也遵循此规则。

移动站的域名需与PC站域名分开,移动站不建议与PC站公用一个域名;比如PC网站域名建议是www.test.com,对应移动站的域名是m.test.com,而不是www.test.com/m/的形式;如果是自适应网站可不考虑此情况。

网站域名选择中,需要规避的是,互联网中一些开放注册的域名,如:

类似的还有:.party,.science等。

此类域名注册成本相对较低,一般是站群作弊者的温床,针对这类域名后缀,不建议各位站长们使用,使用后可能会出现搜索抓取延迟等问题;如有发现正当运营的此类域名站点,请在搜索资源平台验证站点,系统校验站点内容后,则会保持跟其他正常域名一样的抓取优先级。

2.1.2 使用子域名或目录

网站是否需要建立子域名,或是划分多级目录,可根据网站自身定位及网站内容量级决定。通常来说,综合类或内容量较多的网站,可将内容按照不同二级域明确划分;而如果网站内容较少,不建议网站开设过多的子域名。

举例来说,blog形式站点,有的网站给到每个blog作者单独的三级域,但如果作者发布频率较低,整个三级域都是更新频率很低的状态,过低的发布频率对搜索引擎来说是不友好的。

2.2 内容发布系统

内容发布系统,无论是网站自建还是使用第三方建站系统,百度都是支持的;所有发布系统,除遵循有条理、逻辑清晰建站,还要注意网站搭建的安全问题,避免网站安全隐患,才能更好的提升网站价值。

2.2.1 自建内容发布系统

网站自建内容发布系统,注意事项包括:

√ 主体内容清晰且能够很好的识别与分辨;

√ 后台发布时间切勿自行设置,遵循发布时间与展示时间一致;

√ 内容发布系统中各表单设置合理,如对tag标签的设置不宜过多、不宜罗列关键词;

√ 分类划分明确,分类主题的文章对应发布到相应分类下;

√ 题文相符,切勿挂羊头卖狗肉,欺骗搜索引擎流量,损伤用户体验;

√ 段落清晰合理、字体大小适中、字体颜色切勿使用与背景色相近的颜色;

√ 发布内容目录划分清晰,具体参考2.3章节中网站结构设置

2.2.2 第三方发布系统

使用第三方发布系统建站,需要站长关注以下注意事项:

√ 模板主题不建议频繁更换;

√ 类似wordpress等系统,不建议使用过多插件,会影响网页打开速度;

√ URL伪静态的处理,命名规范、层级清晰;

√ 开源建站系统存在较多安全隐患,使用过程中务必做一些安全上的设置和优化;

2.2.3 页面生成规范

无论网站自建发布系统,还是网站使用第三方建站系统,网站页面的生成,都应注意以下几点:

网页结构清晰、各分类名称设置醒目;

导航、面包屑导航设置合理,机器可读、位置突出,用户能很好得知所访问页面在网站中的位置;

不存在遮挡主体内容的广告元素;

无三俗图文、音频元素;

注意网站搭建系统安全问题,杜绝网站安全隐患

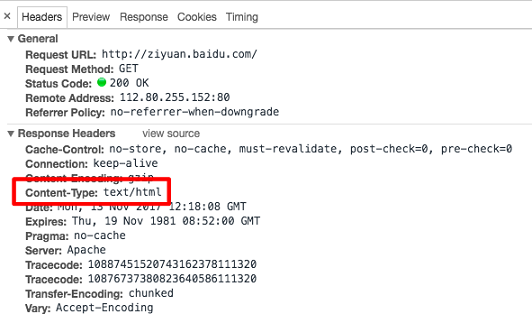

访问请求中的content-type需要根据对应的类型进行正确设置,图示如下:

除此之外,关于页面规范标准,建议参考搜索学院发布的《百度搜索Mobile Friendly(移动友好度)标准V1.0》

2.3 网站结构

合理设置网站结构,是网站被快速抓取、获得搜索流量的基础;因网站结构设置不合理,导致网站无法被快速识别抓取的事例在百度日常反馈中经常见到,且网站换域名也会对网站造成一定损失,故希望各位站长从建站之初重视网站结构设置,避免不必要的损失。

2.3.1 URL结构设置

URL搭建是否有严格要求,请看以下几点注意事项:

在搭建网站结构、制作URL时,尽量避开非主流设计,追求简单美即可,越简单越平常,越好,例如URL中出现生僻字符,如不常见的“II”,会引起搜索引擎识别错误

不建议URL中含有中文字符,中文字符容易出现编码转换问题,造成识别错误

URL长度要求去掉协议头http(s)://之后的url长度不要超过256个字节

谨慎使用#参数,有效的参数不能放在#后面;可能被截断导致网页抓取异常

2.3.2 目录结构设置

网站目录结构搭建是否合理,影响搜索引擎对网站的抓取情况,这里需要提到的是,网站目录结构无论是扁平化还是树形结构,一般都可以被搜索引擎发现,但有以下几点注意事项:

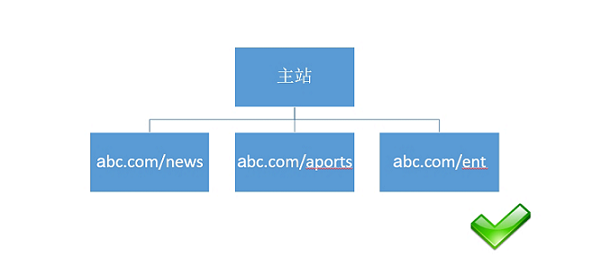

建议不同内容放在不同目录或子域下,域名划分在2.1.2网站域名划分章节中有详细提到

不要使用孤岛链接,孤岛链接很难被搜索引擎快速发现;若网站已存在大量孤岛链接,建议使用搜索资源平台的链接提交工具向百度提交数据

重要内容不建议放在深层目录,若该内容没有大量内链指向,搜索引擎很难判断该页面的重要程度

以下是图片示例:

2.4 服务商/自建服务器

选择服务商或者自建服务器,对网站搭建都是十分重要基础的一环;服务器安全和稳定将直接影响百度搜索引擎对网站的整体判断。

2.4.1 域名服务

2.4.1.1 域名服务&域名部署

关于域名服务和域名部署,有以下注意事项:

√ 站长在域名部署中请仔细各环节问题,不要出现域名部署错误情况

√ 不建议网站进行泛解析,若网站爆发大规模泛解析,且影响恶劣,则会受到搜索策略打压

√ 尽量选择优质域名服务商

2.4.2 服务器

做网站还有非常重要的一环,就是服务器的选择,那服务器选择中,无论是虚拟主机、云主机还是独立的服务器,都应该注意以下四点:

√ 中文网站不建议选择国外服务器

√ 服务器的稳定性非常重要,需要保持访问流畅,服务器是否稳定,可以使用百度搜索资源平台(原百度站长平台)抓取异常、抓取诊断工具进行检测维护。(服务器经常无法访问或者死机,对爬虫来讲都是致命伤害)

√ 服务器选择除了自身的稳定性外,实际上还要考虑网站的业务量,例如带宽、内存、CPU是否能够承受访问量,突发大流量情况下是否可以正常访问。

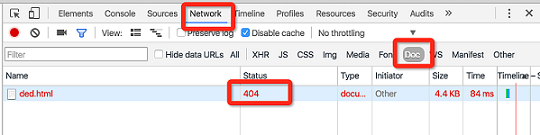

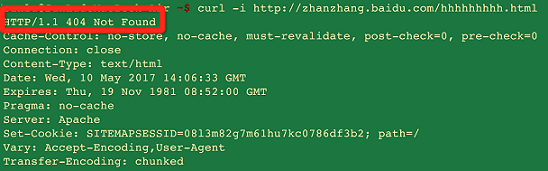

√ 服务器主机设置,需要注意是否有禁止爬虫抓取的设置、或存在404错误信息设置,这些情况都会引起不必要的搜索引擎抓取判断异常,为网站带来不必要的损失。

2.4.2.1 虚拟主机

总的来说,建议虚拟主机选购时候需要特别注意:

√ 主机商是否存在限制搜索引擎访问的情况;

√ 主机商的资质是否符合要求;

√ 主机商的技术沉淀是否足够,建议选择品牌较大的主机商;

√ 主机商托管的机房的物理条件和网络条件是否足够优秀;

√ 主机商的技术和客服支持情况是否够好;

√ 主机商是否会存在超容量的情况;

√ 主机商是否存在违规接入高风险站点的问题或同一IP下是否会存在高风险站点的情况。

√ 国内站点建议选购国内云主机建站;

2.4.2.2 独立主机

独立主机为站点带来更加宽松的使用环境和个性软件的安装,因此独立主机需要站长拥有一定的技术力量来保证网站的正常运行和安全。

我们对于站长选购和托管独立主机的建议是:

√ 注意虚拟主机是否有将爬虫IP拉入黑名单,关于百度UA,可以参考3.1.2.1百度蜘蛛章节;

√ 建议使用独立IP地址的主机;

√ 建议使用规模较大机构的主机,在安全配置、稳定性上相对更好;

√ 对IDC服务商的建设标准需要一定的考虑,例如防火、防盗、是否有UPS保证、室内温控、消防等。

√ IDC服务商的服务质量和技术是否达标,是否24h值班,是否能够协助排查一些故障、免费重启重装系统等。

√ IDC机房的资质是否齐全,存放站点是否有高风险站点或服务器存在。

2.4.3 安全服务

2.4.3.1 HTTPS

当前百度已实行全站化HTTPS安全加密服务,百度HTTPS安全加密已覆盖主流浏览器,旨在用户打造了一个更隐私化的互联网空间、加速了国内互联网的HTTPS化。同时也希望更多网站加入到HTTPS的队伍中来,为网络安全贡献一份力量。

HTTPS安全原理解析

HTTPS主要由有两部分组成:HTTP + SSL / TLS,也就是在HTTP上又加了一层处理加密信息的模块。服务端和客户端的信息传输都会通过TLS进行加密,所以传输的数据都是加密后的数据。HTTPS与HTTP的原理区别可以观察下图:

HTTS复杂的加密机制有效的加大了网站的安全性,加密机制与认证机制可以减少网站被劫持和假冒的风险,建议站长们可以通过做HTTPS改造来强化网站安全。

百度搜索资源平台为了更好的抓取识别HTTPS网站,2017年还推出了HTTPS认证工具,已经完成HTTPS改造的网站,可以在搜索资源平台-网站支持-HTTPS认证工具中提交网站的HTTPS数据,便于百度更好抓取识别网站。关于HTTPS认证工具详解,可以参考5.3.2HTTPS认证工具章节。

2.4.3.2 网站防止被黑对策

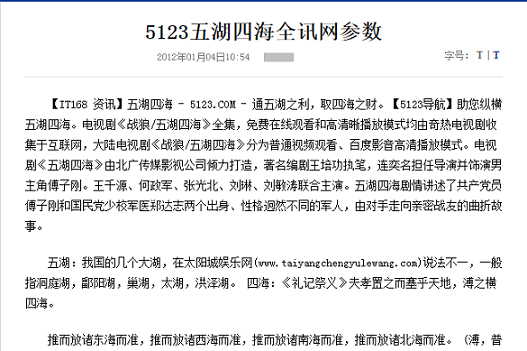

网站被黑,通常表现为网站中出现大量非本网站发布的类似博彩内容,或网站页面直接跳转到博彩页面;以下是网站被黑后发布的内容:

内容非网站发布,内容中含大量博彩网站指向:

网站页面直接跳转到博彩网站:

网站被黑代表网站安全存在严重问题或漏洞,如何防范网站被黑,请参考以下:

首先,自查是否被黑

√ 被黑网站在数据上有一个特点,即索引量和从搜索引擎带来的流量在短时间内异常数据异常。所以,站长可以利用百度搜索资源平台(原百度站长平台)的索引量工具,观察站点索引量是否有异常;如果发现数据异常,再通过流量与关键词工具查看获得流量的关键词是否与网站有关、是否涉及博彩和色情。

√ 通过Site语法查询站点,结合一些常见的色情、博彩类关键词效果更佳,有可能发现不属于站点的非法页面。

√ 由于百度流量巨大,有些被黑行为仅针对百度带来的流量予以跳转,站长很难发现,所以在查看自己站点是否被黑时,一定要从百度搜索结果中点击站点页面,查看是否跳转到了其他站点。

√ 站点内容在百度搜索结果中被提示存在风险。

√ 后续可以请网站技术人员通过后台数据和程序进一步确认网站是否被黑

其次,被黑之后如何处理

√ 确认网站被黑后,SEO人员除了要推动技术人员快速修正外,还需要做一些善后和预防的工作。

√ 网站如有变更页面,变更页面建议使用链接提交工具向百度提交数据

√ 立即停止网站服务,避免用户继续受影响,防止继续影响其他站点

√ 如果同一主机提供商同期内有多个站点被黑,可以联系主机提供商,敦促对方做出应对。

√ 清理已发现的被黑内容,将被黑页面设置为404死链,并通过百度搜索资源平台(原百度站长平台)死链提交工具进行提交。(我们发现有些站点采用了将被黑页面跳转至首页的做法,非常不可取。)

√ 排查出可能的被黑时间,和服务器上的文件修改时间相比对,处理掉黑客上传、修改过的文件;检查服务器中的用户管理设置,确认是否存在异常的变化;更改服务器的用户访问密码。注:可以从访问日志中,确定可能的被黑时间。不过黑客可能也修改服务器的访问日志。

√ 做好安全工作,排查网站存在的漏洞,防止再次被黑。

网站自我防护的注意事项:

√ 多种安全防护同步进行:适合中小型资讯网站

● 网站程序勤打补丁:现在很多资讯类网站用的系统使用了内容管理系统(CMS),作为新闻发布系统,功能还算可以了,但是作为比较常见的内容管理系统(CMS),也有另一个问题,那就是漏洞比较大众化,因为源码是公开的,所以很容易被研究出漏洞,需要对网站程序及时进行漏洞修复。

√ 对服务器进行常规的安全防护

● 在上班时间之外,对服务器上的网站权限做设置,禁止文件修改,后台文件隐藏或迁移到根目录之外

● 参考一些网站的安全设置,非限定的IP不能写入到数据库。

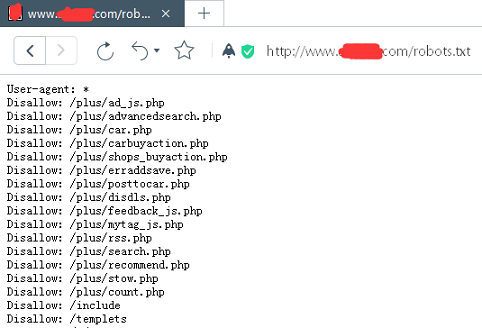

√ 不使用开源程序默认的robots文件

● 下图是一个地级市的资讯类站点的robots文件,从robots文件中可以看出,该网站用的是织梦后台,那黑客就可以通过各种针对织梦攻击的软件进行操作了,也可以针对织梦网站的常见漏洞进行扫描和针对性攻击了。

2.4.4 网络服务

2.4.4.1 CDN

从搜索抓取机制上讲:百度蜘蛛对站点的抓取方式和普通用户访问一样,只要普通用户能访问到的内容,百度蜘蛛就能抓取到。不管是用什么技术,只要能保证用户能流畅的访问网站,对搜索引擎就没有影响。但有站长反馈使用CDN后出现网站抓取异常、甚至流量异常等问题,主要是两方面的因素:

一是部分CDN服务商硬件投入不够,经常出现不稳定情况,会导致大量的蜘蛛抓取失败,从而影响网站抓取效果,有的甚至影响了索引量数据;所以选择有实力的CDN服务商很重要;

二是缓存机制在网站出现死链、无法打开、被黑等情况的时候起到了推波助澜的作用。短时间内产生了一些不利快照,影响了排名。这种情况不用担心,及时清理源文件和CDN缓存,并在百度搜索资源平台(原站长平台)提交相关死链数据等方法进行挽回,是可以恢复的。